Prix Jeunes Chercheurs

3 prix gagnés par nos docteurs à la 27e édition des Prix Jeunes Chercheurs de Clermont-Ferrand :

Prix Clermont Auvergne Innovation pour Guillaume Mougeot, Docteur en Image, système de perception, robotique (ED SPI) pour sa thèse en collaboration avec l'IGReD et Oxford (Nuclear Plant Envelope).

Prix INP Polytech pour Guy Vano Tsamo Tagouche, Docteur en Ingénierie des Matériaux (ED SPI) pour sa thèse.

Prix de la Fondation UCA pour Ismaël Septembre, Docteur en Physique - Milieux denses et matériaux (ED SF) pour sa thèse.

Nous félicitons Sayed Mohammadreza Shetab Bushehri, Docteur en Génie Electrique, Electronique et Systèmes (ED SPI) qui a brillamment défendu la robotique de manipulation des objets déformables.

Plateforme multi-techniques d’élaboration et de caractérisation

L'Institut Pascal, vient de se doter d'un nouveau Système d'Analyse et de Structuration des Surfaces (SASS) grâce aux financements de l'Union Européenne dans le cadre du FEDER, de la Région AURA et avec le soutien de l'UCA.Cette plateforme est dédiée à l’analyse de matériaux organiques et inorganiques avec un volume qui s'étend de la surface à une profondeur d'environ 50-100 Å. Les techniques de caractérisation disponibles sont multiples : AR-XPS, UPS, ARPES, REELS apportant des informations différentes liées à la profondeur d’analyse et à l’interaction du rayonnement électromagnétique avec la matière.

Séminaire axe ISPR

Collaboration Michelin - IP

Dans le cadre d'une collaboration entre l'Institut Pascal et la manufacture Michelin, une démonstration réelle s'est déroulée le jeudi 10 novembre 2022 afin de montrer les capacités d'un véhicule autonome à évoluer à 40 km/h sur une piste particulièrement éprouvante pour les pneumatiques. Cette première démonstration rentre dans un projet plus global qui doit permettre aux deux partenaires de montrer les capacités de ce type de véhicule à réaliser en autonomie certains tests de pneumatiques mais également de travailler sur le développement de nouveaux tests dont certains plus spécifiques pour ces véhicules de demain.

La fête de la science 2022

Pour l'édition 2022 de la Fête de la Science, l'Institut Pascal était présent sur tous ses thèmes de recherche sur des sites différents du campus des Cézeaux. Les démonstrations aux chercheurs en herbe allaient de la plateforme Pavin Solaire, en passant par les véhicules autonomes, les robots et la 3D, les pouvoirs magiques de la lumière noire et sous forme d'un escape game pour les mystères des capteurs de gaz.

Journées robotiques agricoles

Les deux journées techniques du réseau R2M et du projet AgROBOFood co organisées par INRAE, CEA et Institut Pascal ont lieu ces 12 & 13 octobre sur le site de Montoldre autour des thèmes de la navigation, la sécurité et l’intelligence artificielle pour le développement de robots mobiles en agriculture et en environnement ouvert.

High level dataflow programming for FPGAs

CAPH is a domain-specific language for describing and implementing stream-processing applications on reconfigurable hardware, such as FPGAs. CAPH generates VHDL code from high-level descriptions of signal or image processing applications. CAPH relies upon the actor/dataflow model of computation. Applications are described as networks of purely dataflow actors exchanging tokens through unidirectional channels and the behavior of each actor is defined as a set of transition rules using pattern matching.

- Higher-order, purely functional language for description of complex dataflow networks

- Rich type system with sized-integers, booleans, floats, fully polymorphic algebraic data types and dependent types

- Automatic type inference and type-checking

- Stateful actors

- Pattern-matching based description of actor behavior

- Graphical visualization of dataflow networks

- Code simulation with trace facilities

- SystemC back-end for simulation

- Generates target-independent, ready-to-synthetize VHDL code

- Foreign-function interface to use existing SystemC or VHDL code

More information on the dedicated website.

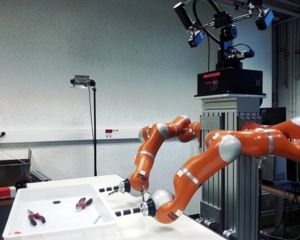

Our bi-arm platform

Our bi-arm platform is composed of two Kuka LWR arms, a Shadow hand equiped with five Biotac tactile sensors, a Barrett hand, force sensors, a pan-tilt-zoom stereo-camera head and RGBD-cameras.

Visual servoing of the bi-arm platform

Our bi-arm platform is composed of two Kuka LWR arms, a Shadow hand equiped with five Biotac tactile sensors, a Barrett hand, force sensors, a pan-tilt-zoom stereo-camera head and RGBD-cameras.

UGV/UAV Visual Control

The first video illustrates a realistic simulation example where twelve Pioneer 3-AT mobile robots are driven to a circular desired configuration using three camera-equipped UAVs. The video is divided into four windows, which show: a general view of the system (top-left), a subjective view focused on one UAV (top-right), a subjective view focused on one mobile robot (bottom-left), and the sequence of images captured by one of the UAV-mounted cameras (bottom-right).

UGV/UAV Visual Control

The second video illustrates an experiment with four Khepera III robots, which are driven to a square-shaped desired configuration using the images captured by two cameras. One of them is fixed over the workspace, while the other is manually handled and moves throughout the experiment. The video is divided into three windows, which show: the sequence of images captured by the moving camera (top-left), the sequence of images captured by the fixed camera (bottom-left), and the motion of the robots registered by an external video camera (right).

Visual Control by pushing

By pushing, the two arms are visually controlled.

Visual Control by pushing

Using visual servoing, objects can also be pushed with mobile robots.

Robotized meat cutting

We developed with our partners of the SRDViand project a robotic platform for automatic meat cutting. The cutting trajectory is computed using active vision and it is tracked with vision/force based control strategies.

Vision-based Autonomous control of an electrical vehicle

The Electrical vehicle is controlled using visual information provided by a fish-eye camera. The visual memory concept is exploited to localize the vehicle.

UGV/UAV Visual Control

The UGVs are controlled using visual features provided by the UAVs.

Modélisation, Identification et Commande (MACCS)

Présentation

MACCS signifie Modélisation, Autonomie et Contrôle dans les Systèmes Complexes. C'est une équipe de recherche de l'Institut Pascal (UMR 6602 CNRS / UBP / SIGMA). Nos recherchent portent principalement sur la modélisation et le contrôle de robots mobiles et manipulateurs, la vision des robots, la vision active, la maitrise visuelle et les comportements d'anticipation. Les applications de nos recherches sont liées à la fabrication robotisée et aux systèmes de transport intelligents.

Notre recherche porte principalement sur:

- AV - Les véhicules autonomes

- Robot et contrôle multi-robots (Non Lineaire, Adaptif, Prédictif, Robuste)

- Mobilité renforcée (Sliding et Slipping) et dynamiques incertaines

- Architecture de contrôle hybride et surveillance

- Evitement d'obstacle

- Robots (Mobile, AGV, All Terrain vehicles, Agricultural Vehicles, Platoon, Multi-Robot System)

- MLPC - Modélisation, apprentissage et perception pour la commande

- Commande d'apprentissage pour robot

- Perception active

- Maitrise visuelle

- Contrôle multi -bras et redondance

Responsable

| Responsable | Youcef Mezouar | Cette adresse e-mail est protégée contre les robots spammeurs. Vous devez activer le JavaScript pour la visualiser. | +33 4 7340 7589 |

| Responsable adjoint | Lounis Adouane | Cette adresse e-mail est protégée contre les robots spammeurs. Vous devez activer le JavaScript pour la visualiser. | +33 4 7340 7245 |

DCSLAM with basic shapes and 3d models points edges

DCSLAM with basic shapes and points

Slam with planar constrain

Flying cube

Realtime slam

Realtime Multi-Object Tracking

Slam